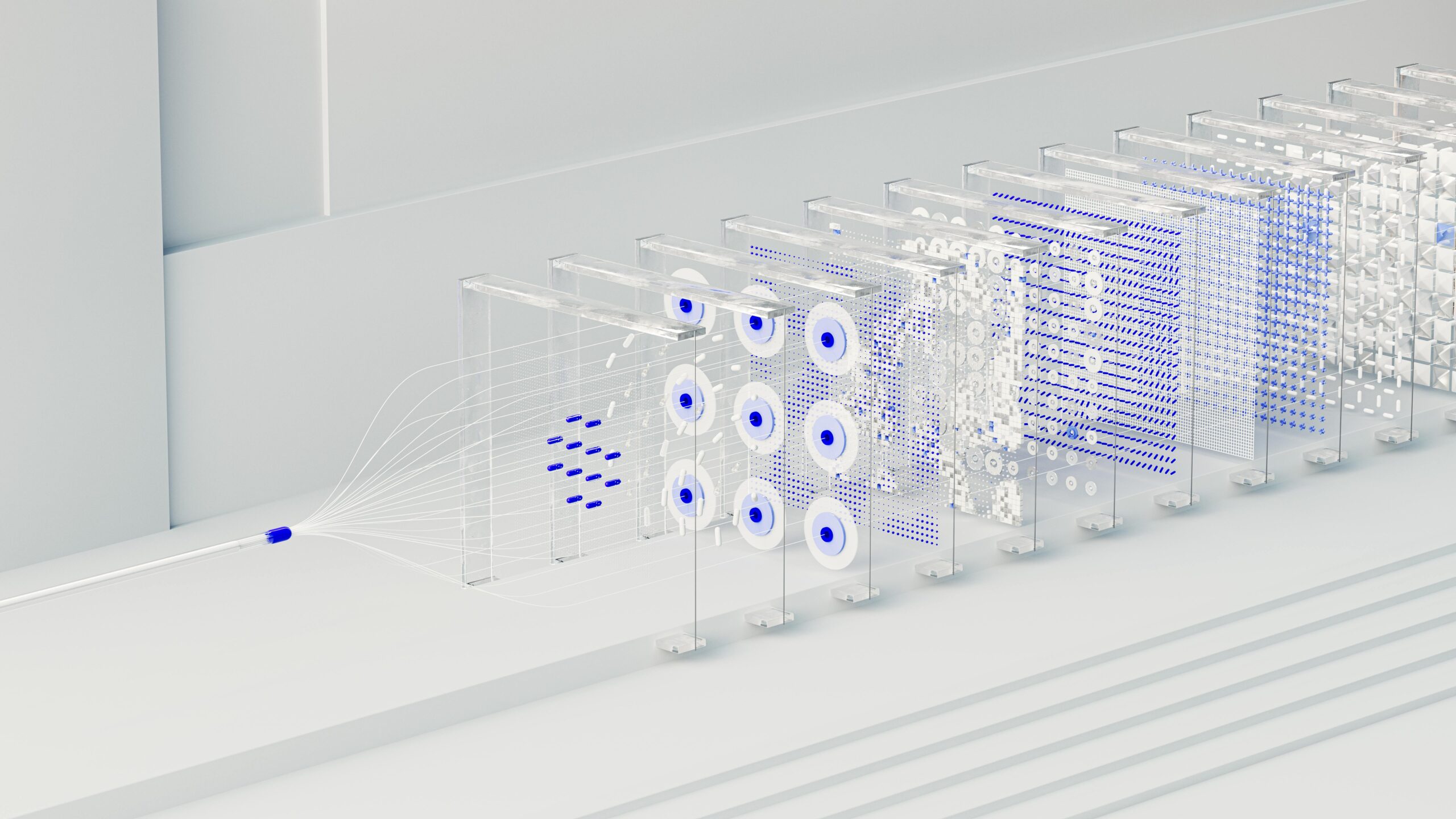

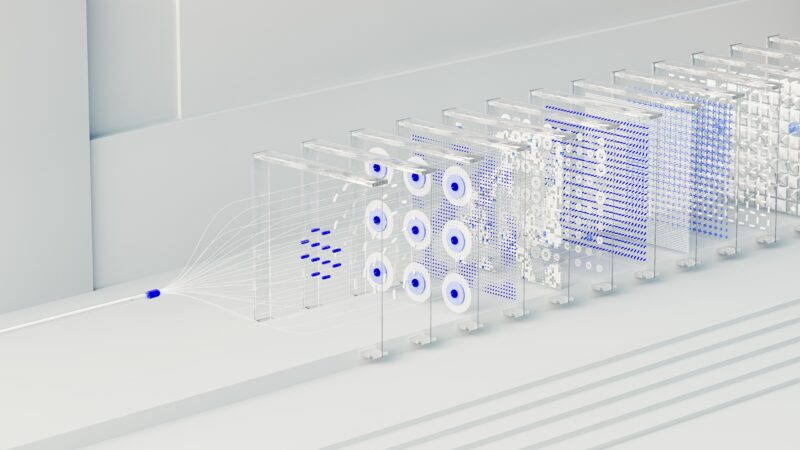

大模型为什么这么聪明?秘密全在训练数据里。本文从数据来源、规模、质量、版权争议到未来趋势,用真实数据和行业观点揭开AI背后的'饲料'真相。读完你会明白为什么有些模型更靠谱,以及数据如何决定AI的能力边界。

你肯定有过这种感觉——跟ChatGPT聊着聊着,突然觉得它像个无所不知的学霸,上知天文下知地理。但你可能没想过,这个’学霸’其实只是读过的书比你多得多。它没有真正的思考,全靠训练数据里’喂’进去的东西来模仿人类。今天咱们就来扒一扒,这些大模型背后,到底藏着什么样的数据秘密。

训练数据到底从哪来?互联网的’大杂烩’

你可能以为大模型的训练数据是精心挑选的教科书、经典文学、权威论文。实际上,大部分数据来自互联网上你能想到的任何角落——网页、论坛、博客、新闻、代码仓库、电子书,甚至Reddit上的吵架帖。OpenAI的GPT-3训练数据里,有60%来自Common Crawl,这是一个公开的网页爬取数据集,几乎把整个公开互联网都抓下来了。剩下的还有维基百科、书籍语料、Reddit链接、甚至Github上的代码。

圈内有个说法挺实在:’垃圾进,垃圾出’。数据来源杂,意味着里面什么都有——正确的、错误的、过时的、偏见的、甚至恶意的。所以大模型有时候会一本正经地胡说八道,根源就在这里。

数据规模有多大?数字说出来吓人

有个数据挺有意思——GPT-3的训练数据总量大约是570GB,相当于超过3000亿个token(单词或子词)。这什么概念?如果你每天读一本10万字的书,要读8000年才能读完这么多内容。而到了GPT-4,虽然官方没公布具体数字,但业内普遍认为数据量至少是GPT-3的几倍,甚至可能达到万亿token级别。

Meta的Llama 3训练用了超过15万亿token,是GPT-3的50倍。Google的Gemini更是号称用了多模态数据,规模难以估算。这背后是巨大的算力和电力消耗——训练一个GPT-3级别的模型,碳排放相当于一辆汽车行驶70万公里。数据越大,成本越高,这也是为什么只有少数巨头玩得起。

数据质量才是真正的’秘密武器’

你可能觉得,数据量大就是王道。其实不然。真正让模型变聪明的,是数据清洗和过滤的功夫。OpenAI的论文里提到,他们用了多层过滤:去重(去掉重复内容)、过滤低质量内容(比如广告、乱码)、去除个人隐私信息,还用了分类器打分,只保留高质量网页。

我个人的经验是,很多团队只关注模型架构,却忽视了数据质量。实际上,数据清洗能占整个项目时间的60%以上。比如,Common Crawl原始数据里有大量垃圾信息——自动生成的SEO文章、机器翻译的蹩脚文本、甚至低俗内容。如果不处理,模型就会学会这些模式。圈内流传一个观点:’数据清洗比模型设计更重要’,这话一点不夸张。

除了清洗,还有’数据配比’。比如,训练GPT-3时,Common Crawl占60%,但权重被降低,而维基百科和书籍虽然只占很小比例,却被赋予了更高权重,因为它们质量更高。这种’偏心’策略,让模型在通用知识上表现更好。

版权和伦理的灰色地带:你的作品被’偷’了吗?

最近几年,版权问题成了大模型绕不开的坎。很多作者发现自己的书、文章、甚至代码被用来训练模型,却没有得到任何授权或报酬。2023年,一群作家起诉OpenAI,指控它未经许可使用他们的作品。类似案例越来越多。

说实话,这个问题挺复杂。从技术角度看,模型只是’学习’了数据的统计规律,并没有直接复制原文。但从伦理角度看,创作者的作品被免费使用,确实不公平。有个观点我挺认同:’如果AI能替你写文章,那写文章的人凭什么得不到回报?’目前,一些公司开始尝试’数据许可’模式,比如Reddit向AI公司收费提供数据,Getty Images也起诉了Stability AI。未来,数据来源的合法性和透明度会成为大模型的核心竞争力。

未来趋势:合成数据与私有数据

互联网上的公开数据快被’榨干’了。研究显示,高质量文本数据可能在2026年前就会被用完。怎么办?合成数据成了新方向——用模型自己生成数据来训练自己。比如,Google的PaLM 2就用了大量合成数据来提升推理能力。但合成数据也有风险:如果模型反复学习自己生成的内容,可能会产生’模型坍缩’,导致多样性下降。

另一个趋势是私有数据——企业用自己的内部数据训练垂直模型。比如,金融公司用交易记录和研报训练投资助手,医院用病历训练诊断模型。这些数据质量高、针对性强,但隐私和合规问题也更棘手。未来,谁能拿到高质量、合规的私有数据,谁就能在AI赛道上领先。

说到底,训练数据就像AI的’基因’。数据好不好,直接决定了模型的上限。下次你用ChatGPT的时候,不妨想想它背后那个庞大的、杂乱的、充满秘密的数据世界。如果你对数据质量感兴趣,可以试试自己清洗一个小数据集,用开源模型跑一下,你会发现数据的力量远比想象中大。

暂无评论内容